Auf dieser Seite

[-]

-

Hintergrund: Datenschutzgesetze DSGVO & TTDSG und ihre Bedeutung

-

Datenschutzbedenken im Zusammenhang mit ChatGPT und KI

-

Der KI Act der Europäischen Union und seine Auswirkungen

-

Best Practices und Empfehlungen für den Umgang mit ChatGPT und ähnlichen KI-Technologien

-

Zusammenfassung und Schlussfolgerungen

Die Entwicklung von künstlicher Intelligenz (KI) und ihre Auswirkungen auf den Datenschutz und die Datenrechtsprechung sind von besonderem Interesse. Ein Beispiel für eine solche Technologie ist ChatGPT, ein sprachbasiertes KI-System von OpenAI. Das Potenzial dieser Technologie ist beeindruckend, doch sie birgt auch erhebliche datenschutzrechtliche Herausforderungen.

Ziel dieses Artikels ist es, die Gefahren hinsichtlich des Datenschutzes und der Datenrechtsprechung im Zusammenhang mit ChatGPT aufzuzeigen, wobei eine strenge Interpretation der Datenschutzgesetze, insbesondere der DSGVO, des TTDSG und des LDSG Baden-Württemberg, zugrunde gelegt wird. Des Weiteren werden mögliche Entwicklungen im Umgang mit KI betrachtet und die relevanten gesetzlichen Rahmenbedingungen näher beleuchtet.

Bitte beachten Sie, dass dieser Artikel lediglich zu Informations- und Orientierungszwecken dient und keine Rechtsberatung darstellt. Wir sind keine Datenschutzrechtsexperten, und der Inhalt des Artikels sollte nicht als verbindliche rechtliche Anleitung oder Empfehlung interpretiert werden. Bei Fragen zu Ihrer spezifischen Situation oder bei Unsicherheiten bezüglich der rechtlichen Anforderungen im Kontext des Einsatzes von KI-Systemen wie ChatGPT empfehlen wir Ihnen, sich an einen qualifizierten Rechtsanwalt oder Datenschutzexperten zu wenden, der Ihnen eine fundierte und auf Ihre individuellen Gegebenheiten zugeschnittene Beratung bieten kann.

Hintergrund: Datenschutzgesetze DSGVO & TTDSG und ihre Bedeutung

Die DSGVO und ihre Bedeutung für Unternehmen und Verbraucher

Die Datenschutz-Grundverordnung (DSGVO) ist ein umfassendes Datenschutzgesetz, das am 25. Mai 2018 in der gesamten Europäischen Union (EU) in Kraft getreten ist. Die DSGVO hat zum Ziel, den Schutz personenbezogener Daten von EU-Bürgern zu stärken und den Datenschutz innerhalb des EU-Binnenmarktes zu harmonisieren. Für Unternehmen und Organisationen, die personenbezogene Daten von EU-Bürgern verarbeiten, ist es verpflichtend, sich an die DSGVO zu halten. Die DSGVO definiert personenbezogene Daten als alle Informationen, die sich auf eine identifizierte oder identifizierbare natürliche Person beziehen, und legt Grundsätze für die Verarbeitung dieser Daten fest.

Das TTDSG und seine Relevanz in Deutschland

Das Telekommunikation-Telemedien-Datenschutz-Gesetz (TTDSG) ist ein deutsches Bundesgesetz, das im November 2021 in Kraft getreten ist. Das TTDSG regelt den Datenschutz bei Telekommunikations- und Telemedien-Dienstleistungen und ergänzt die DSGVO auf nationaler Ebene. Es verpflichtet Anbieter solcher Dienstleistungen, die Daten ihrer Nutzer zu schützen und den Datenschutzbestimmungen nachzukommen. Zu den Schwerpunkten des TTDSG gehören unter anderem Regelungen zur Verarbeitung von Standortdaten, zur Speicherung von Kommunikationsinhalten und zur Nutzung von Cookies. Unternehmen und Organisationen in Deutschland müssen sich sowohl an die DSGVO als auch an das TTDSG halten, wenn sie personenbezogene Daten verarbeiten.

Das LDSG Baden-Württemberg und seine Anwendung auf regionaler Ebene

Das Landesdatenschutzgesetz Baden-Württemberg (LDSG) ist ein Gesetz auf Landesebene, das den Datenschutz für öffentliche Stellen in Baden-Württemberg regelt. Es ergänzt die DSGVO und das TTDSG in Bezug auf die Verarbeitung personenbezogener Daten durch öffentliche Stellen und schafft einen rechtlichen Rahmen für den Datenschutz in diesem Bereich. Das LDSG Baden-Württemberg legt besonderen Wert auf die Sicherheit und Vertraulichkeit von Daten und verpflichtet öffentliche Stellen, geeignete technische und organisatorische Maßnahmen zu ergreifen, um den Datenschutz zu gewährleisten. Die Regelungen des LDSG Baden-Württemberg sind für Unternehmen und Organisationen relevant, die mit öffentlichen Stellen in Baden-Württemberg zusammenarbeiten oder deren Daten verarbeiten.

Die DSGVO, das TTDSG und das LDSG Baden-Württemberg bilden zusammen einen umfassenden Rechtsrahmen für den Datenschutz und die Datenrechtsprechung im Zusammenhang mit KI-Anwendungen wie ChatGPT. Im Folgenden werden die Datenschutzbedenken im Zusammen.

Datenschutzbedenken im Zusammenhang mit ChatGPT und KI

Datensammlung und -verarbeitung

KI-Systeme wie ChatGPT benötigen große Mengen an Daten, um effektiv zu funktionieren. Die Sammlung, Speicherung und Verarbeitung dieser Daten können jedoch datenschutzrechtliche Bedenken aufwerfen, insbesondere wenn es sich um personenbezogene Daten handelt. Unternehmen und Organisationen, die ChatGPT einsetzen, müssen daher sicherstellen, dass sie die einschlägigen Datenschutzgesetze wie die DSGVO, das TTDSG und das LDSG Baden-Württemberg einhalten.

Risiken der automatisierten Entscheidungsfindung

ChatGPT kann für automatisierte Entscheidungsfindung und Profiling eingesetzt werden. Solche Anwendungen können jedoch rechtliche und ethische Bedenken hervorrufen, insbesondere wenn sie zu diskriminierenden oder unfairen Ergebnissen führen. Artikel 22 der DSGVO schützt betroffene Personen vor automatisierten Entscheidungen, die für sie rechtliche Wirkung entfalten oder sie erheblich beeinträchtigen. Unternehmen, die ChatGPT für solche Zwecke nutzen, müssen die gesetzlichen Vorgaben beachten und mögliche Risiken minimieren.

Mögliche Diskriminierung und Verzerrung

KI-Systeme wie ChatGPT können aufgrund von Verzerrungen in den Trainingsdaten diskriminierende oder voreingenommene Ergebnisse erzeugen. Dies kann zu unfairen Entscheidungen führen und gegen die Grundsätze der DSGVO, des TTDSG und des LDSG Baden-Württemberg verstoßen. Um Diskriminierung und Verzerrungen zu vermeiden, müssen Unternehmen und Organisationen, die ChatGPT einsetzen, ihre KI-Systeme kontinuierlich überwachen und entsprechende Korrekturmaßnahmen ergreifen.

Missbrauch von Daten und Informationen

Der Missbrauch von Daten und Informationen, die von ChatGPT generiert oder verarbeitet werden, ist ein weiteres Datenschutzrisiko. Dies kann etwa den unbefugten Zugriff auf sensible Daten oder die Verwendung von Informationen für unzulässige Zwecke umfassen. Die eingegebenen Informationen, die auch beim “normalen” Prompten von ChatGPT gespeichert werden, stellen unter anderem ein Datenschutzrisiko dar. Um solche Risiken zu minimieren, sollten Unternehmen und Organisationen, die ChatGPT verwenden, strenge Sicherheitsmaßnahmen implementieren und ihre Datenverarbeitungsprozesse regelmäßig überprüfen.

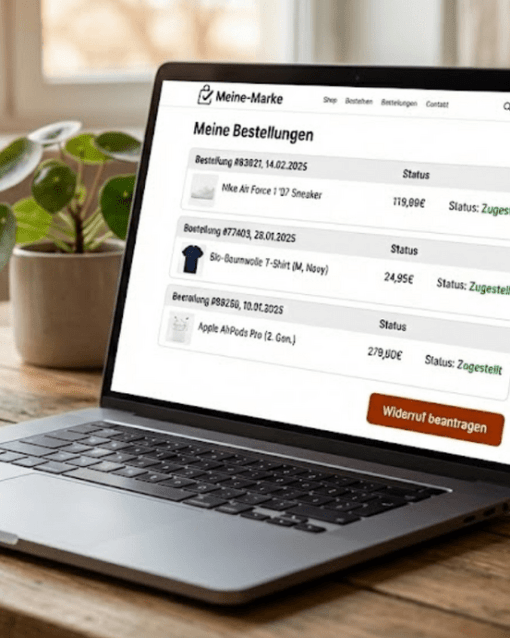

Ein alltägliches Beispiel für die Nutzung von ChatGPT im E-Commerce könnte ein Kundensupport-Chatbot sein, der auf einer Website oder in einem Online-Shop eingesetzt wird, um Kundenanfragen zu beantworten und Hilfestellungen zu geben. In diesem Szenario würden die Eingaben der Nutzer (“geprombte” Daten) von ChatGPT verarbeitet, um passende Antworten zu generieren.

Die von Nutzern eingegebenen Daten können personenbezogene Informationen enthalten, wie Namen, E-Mail-Adressen oder spezifische Anliegen. Die Verarbeitung dieser Daten durch ChatGPT unterliegt den datenschutzrechtlichen Vorgaben der DSGVO, des TTDSG und des LDSG Baden-Württemberg, sofern die Organisation in Deutschland ansässig ist oder ihre Dienste deutschen Nutzern anbietet. Die rechtlich relevanten Folgen können von Bußgeldern bis zu Schadensersatzansprüchen betroffener Personen reichen.

Um die Einhaltung der Datenschutzgesetze sicherzustellen, sollten Unternehmen und Organisationen, die ChatGPT in solchen Anwendungsfällen nutzen, folgende Maßnahmen ergreifen:

WICHTIG: Sprich mit deinem Datenschutzbeauftragten. Maßnahmen und Implementierungen sollten unbedingt auf einer fundierten Rechtsberatung beruhen. Sichere dich ab. Dieser Artikel und die folgenden Punkte sind wie oben erwähnt keine Rechtsberatung, sondern dienen nur einer allgemeinen groben Darstellung möglicher Maßnahmen.

-

Informiere die Nutzer über die Verwendung von ChatGPT und die damit verbundene Datensammlung und -verarbeitung gemäß Artikel 13 und 14 der DSGVO. Holen Sie bei Bedarf die Zustimmung der Nutzer für die Verarbeitung Ihrer personenbezogenen Daten ein, insbesondere wenn es um sensible Daten geht.

-

Stelle sicher, dass die Daten nur für den ursprünglich vorgesehenen Zweck verarbeitet werden und nicht für andere, inkompatible Zwecke verwendet werden.

-

Implementiere angemessene Sicherheitsmaßnahmen, um die personenbezogenen Daten vor unbefugtem Zugriff oder Missbrauch zu schützen.

-

Lösche oder anonymisiere personenbezogene Daten, sobald sie für den ursprünglichen Zweck nicht mehr benötigt werden, um den Grundsatz der Datensparsamkeit und Datenminimierung zu wahren.

-

Vermeide die Weitergabe von sensiblen oder personenbezogenen Informationen: Mitarbeiter:innen sollten darauf achten, keine sensiblen oder personenbezogenen Daten in ihren Kommunikationen mit ChatGPT preiszugeben, um das Risiko einer unbefugten Verarbeitung oder Offenlegung zu minimieren.

-

Anonymisierung oder Pseudonymisierung von Daten: Wenn es notwendig ist, personenbezogene Daten in der Kommunikation mit ChatGPT zu verwenden, sollten Mitarbeiter:innen in Erwägung ziehen, die Daten zu anonymisieren oder zu pseudonymisieren, um den Datenschutz zu gewährleisten.

-

Sensibilisierung und Schulung der Mitarbeiter:innen: Unternehmen und Organisationen sollten ihre Mitarbeiter:innen im Umgang mit KI-Systemen wie ChatGPT schulen und sensibilisieren, um sicherzustellen, dass sie sich der Datenschutzbestimmungen bewusst sind und diese einhalten.

Verantwortlichkeit und Haftung

Im Zusammenhang mit ChatGPT und anderen KI-Systemen stellt sich die Frage der Verantwortlichkeit und Haftung für Datenschutzverletzungen oder -verstöße. Unternehmen und Organisationen, die ChatGPT nutzen, müssen sicherstellen, dass sie die gesetzlichen Vorgaben einhalten und für die Einhaltung der Datenschutzgesetze verantwortlich sind. Dies kann die Bestellung eines Datenschutzbeauftragten, die Durchführung von Datenschutz-Folgenabschätzungen oder die Implementierung von Datenschutzmaßnahmen auf technischer und organisatorischer Ebene umfassen.

Der KI Act der Europäischen Union und seine Auswirkungen

Hintergrund und Ziele des KI Act

Der KI Act ist ein Gesetzesvorschlag der Europäischen Kommission, der darauf abzielt, einen rechtlichen Rahmen für künstliche Intelligenz (KI) in der Europäischen Union (EU) zu schaffen. Der Vorschlag zielt darauf ab, das Vertrauen in KI-Anwendungen zu fördern und gleichzeitig den Schutz der Grundrechte der Nutzer und die Sicherheit der KI-Systeme zu gewährleisten. Der KI Act legt bestimmte Anforderungen und Pflichten für Anbieter und Nutzer von KI-Systemen fest, insbesondere in Bezug auf Transparenz, Datenschutz und Haftung.

Klassifizierung von KI-Systemen und Anforderungen

Der KI Act klassifiziert KI-Systeme in verschiedenen Risikokategorien, von minimalen bis zu hohen Risiken. Je höher das Risiko, desto strenger sind die Anforderungen und Pflichten, denen die Anbieter und Nutzer von KI-Systemen unterliegen. Desto höher werden auch bei Nichteinhaltung die Bußgelder. Diese werden auch deutlich über den bisherigen DSGVO typischen Bußgeldern liegen. Hochrisiko-Systeme sind unter anderem Systeme im Bereich der biometrischen Identifizierungen (z.B. Gesichtserkennung) oder der kritischen Infrastruktur (Straßenverkehr, Wasser-, Gas-, Wärmeversorgungen etc.). Für KI-Systeme, die als “gering” oder “minimal” eingestuft werden, möchte die EU Transparenzvorschriften einführen, die gelten, wenn Anwendungen in Interaktion mit Menschen verwendet werden, Emotionen erkennen oder Inhalte erzeugen bzw. manipulieren (z. B. “Deepfakes”). In solchen Fällen muss sichergestellt werden, dass die Nutzer über den Einsatz von KI oder den KI-Ursprung informiert sind. Ausnahmen von dieser Regel gelten unter bestimmten Bedingungen für KI-Systeme, die “gesetzlich zur Aufdeckung, Verhinderung, Untersuchung und Strafverfolgung von Straftaten zugelassen” sind.

Anbieter müssen etwa von KI-Systemen mit hohem Risiko eine Konformitätsbewertung durchführen und sicherstellen, dass ihre Systeme den Vorgaben des KI Act entsprechen, eine detaillierte technische Dokumentation aufweisen können. Nutzer von KI-Systemen sind verpflichtet, die Systeme gemäß den Anforderungen des KI Act einzusetzen und die Einhaltung der Vorgaben zu überwachen.

Auswirkungen auf ChatGPT und die Nutzung von KI

Der KI Act wird voraussichtlich Auswirkungen auf die Nutzung von KI-Systemen wie ChatGPT haben. Unternehmen und Organisationen, die ChatGPT einsetzen, müssen die Anforderungen des KI Act berücksichtigen und sicherstellen, dass sie die gesetzlichen Vorgaben einhalten. Je nachdem in welchem “System” ChatGPT zum Einsatz kommt, also ob dies beispielsweise ein System der kritischen Infrastruktur ist und somit ein hohes Risiko einhergeht, können die Auswirkungen und Maßnahmen unterschiedlich ausfallen. Dies kann beinhalten, dass sie ihre KI-Anwendungen auf Datenschutz- und Sicherheitsrisiken überprüfen, Transparenz über die Verwendung von KI bieten und möglicherweise Anpassungen an ihre Systeme vornehmen, um den Anforderungen des KI Act gerecht zu werden. Durch die Einhaltung des KI Act können Unternehmen und Organisationen das Vertrauen in ihre KI-Anwendungen stärken und das Risiko von rechtlichen Konsequenzen reduzieren.

Wer den aktuellen Rahmen des KI Acts der EU in voller länge lesen möchte, kann das https://eur-lex.europa.eu/legal-content/DE/TXT/HTML/?uri=CELEX:52021PC0206&from=DE.

Best Practices und Empfehlungen für den Umgang mit ChatGPT und ähnlichen KI-Technologien

-

Datenschutz-Folgenabschätzung Unternehmen und Organisationen sollten eine Datenschutz-Folgenabschätzung (DSFA) durchführen, um potenzielle Risiken bei der Verwendung von ChatGPT oder ähnlichen KI-Systemen zu identifizieren und zu bewerten. Die DSFA hilft dabei, Datenschutzrisiken frühzeitig zu erkennen und geeignete Maßnahmen zur Risikominderung zu entwickeln.

-

Transparenz und Aufklärung der Nutzer Es ist wichtig, Nutzer über den Einsatz von KI-Systemen wie ChatGPT aufzuklären und Transparenz hinsichtlich der Datensammlung und -verarbeitung zu gewährleisten. Unternehmen sollten klar kommunizieren, wie und warum ihre KI-Systeme eingesetzt werden und Informationen über die Verwendung und Speicherung von personenbezogenen Daten bereitstellen.

-

Datensparsamkeit und Minimierung der Verarbeitung Unternehmen sollten den Grundsatz der Datensparsamkeit und Datenminimierung befolgen, indem sie nur die notwendigen personenbezogenen Daten erfassen und verarbeiten. Eine begrenzte Datenspeicherung und die Anonymisierung oder Pseudonymisierung von Daten, wo immer möglich, tragen dazu bei, das Risiko von Datenschutzverletzungen zu verringern. Hierzu gehören beispielsweise auch keine sensiblen Daten wie Unternehmensgeheimnisse oder persönliche Daten einzupflegen. Diese können vorab anonymisiert werden. Wer beispielsweise aktuell beruflich mit ChatGPT arbeitet, sollte Firmen, Kunden und persönliche Daten “anonymisieren” und durch Pseudonyme ersetzen.

-

Ethische und rechtliche Überlegungen Der Einsatz von KI-Systemen wie ChatGPT sollte ethischen und rechtlichen Grundsätzen entsprechen. Unternehmen und Organisationen müssen sicherstellen, dass ihre KI-Anwendungen die Grundrechte der Nutzer respektieren und keine Diskriminierung fördern. Die Einhaltung von Datenschutzgesetzen wie der DSGVO, des TTDSG und des LDSG Baden-Württemberg ist ebenfalls entscheidend.

-

Kontinuierliche Überwachung und Anpassung Die Nutzung von KI-Systemen erfordert eine kontinuierliche Überwachung und Anpassung, um auf sich ändernde rechtliche Rahmenbedingungen und technologische Entwicklungen zu reagieren. Unternehmen sollten regelmäßig ihre KI-Systeme überprüfen und aktualisieren, um die Einhaltung von Gesetzen und Best Practices sicherzustellen und mögliche Risiken proaktiv anzugehen.

-

Strategische Fragen zur Implementierung von KI-Systeme Überlegen Sie sich genau, WELCHES KI-System WO bei Ihnen Anwendung finden soll.

Folgende Fragen können Ihnen hierbei helfen:

Fragen zum KI-System:

- Welche Prozesse lassen sich hiermit optimieren oder automatisieren?

- Welche Schnittstellen müssen hierfür “angezapft” und angebunden werden?

- Welche Daten benötigt das System? Können diese auch anonymisiert oder pseudonymisiert werden?

- Welchen Mehrwert an Qualität bringt das System für meine Kunden? Mitarbeiter? Partner?

- Wer hat das KI-System entwickelt? In welchem Land werden ggf. die verwendeten Daten weiterverwendet?

- Ist der Entwickler/ Hersteller vertrauenswürdig?

Fragen zu Ihrer Organisation:

- Welche Prozesse müssen optimiert werden? Für welche gibt es “Marktreife” Lösungen?

- Wie muss ich meine Organisation und Geschäftsprozesse hinsichtlich der Risikobewertung des EU-Acts einordnen?

- Welche Anforderungen muss ich entsprechend an das System stellen?

- Welche Maßnahmen muss ich ableiten?

- Welchen Wettbewerbsvorteil kann mir das System bieten? Zum Beispiel hinsichtlich Skalierung, Ressourcen, Schnelligkeit etc.

Gerne erörtern wir unter anderem diese Fragen gemeinsam mit Ihnen, um das für Sie geeignete KI-System anzubinden. Für die Klärung rechtlicher Fragen, werden wir mit unseren oder Ihren Partnern zusammenarbeiten.

Kontaktieren Sie uns

Zusammenfassung und Schlussfolgerungen

Empfohlene Maßnahmen

Unternehmen und Organisationen sollten Best Practices und Empfehlungen befolgen, um die Einhaltung der Datenschutzgesetze bei der Nutzung von ChatGPT und ähnlichen KI-Systemen sicherzustellen. Dazu gehören die Durchführung einer Datenschutz-Folgenabschätzung, die Gewährleistung von Transparenz und Nutzeraufklärung, die Anwendung von Datensparsamkeit und Datenminimierung, die Berücksichtigung ethischer und rechtlicher Überlegungen sowie die kontinuierliche Überwachung und Anpassung der KI-Systeme. Durch die Implementierung dieser Maßnahmen können Unternehmen das Vertrauen in ihre KI-Anwendungen stärken und das Risiko von rechtlichen Konsequenzen reduzieren.