Der EU AI Act schafft verbindliche Regeln für Onlineshops und digitale Plattformen

Die Europäische Union (EU) hat mit dem Artificial Intelligence Act (AI Act) das weltweit erste umfassende Gesetz zur Regulierung von künstlicher Intelligenz verabschiedet. Das Thema taucht seitdem immer wieder in Berichten und Diskussionen auf, vor allem wenn es um Transparenz, Verantwortung und mögliche Pflichten für Unternehmen geht. Gerade für Onlineshops, digitale Plattformen und andere E-Business-Unternehmen wird der AI Act damit zunehmend relevant, denn künstliche Intelligenz wird dort längst in Marketing, Kundenservice, Content und internen Prozessen eingesetzt.

Doch es gibt keinen Grund zur Panik. Das Ziel dieses Gesetzes ist es nicht, neue Technologien zu stoppen. Die Politik betrachtet das Gesetz vielmehr als eine Art Produktsicherheit für Software. Der wesentliche Hintergrund des Gesetzes ist der Schutz der Verbraucher durch Transparenz. Nutzer müssen künftig immer erkennen können, ob sie mit einer Maschine interagieren oder künstlich erzeugte Inhalte konsumieren, damit sie informierte Entscheidungen treffen können.

Wir dröseln das Thema in diesem Beitrag auf, damit du genau verstehst, welche Pflichten auf dein Unternehmen zukommen und wie du diese strukturiert lösen kannst.

Die Rollenverteilung im AI Act: Wer genau handeln muss

Um zu verstehen, welche Pflichten dich treffen, ist eine grundlegende begriffliche Unterscheidung des Gesetzes wichtig. Das Regelwerk kennt nicht einfach nur Anbieter und Anwender, sondern definiert vier spezifische Akteure:

-

Der Provider: Das ist das Unternehmen, das ein intelligentes Modell oder System entwickelt und unter eigenem Namen auf den Markt bringt. Die rechtlichen Hürden für diese Unternehmen sind extrem hoch.

-

Der Deployer: Das ist das Unternehmen, das ein bestehendes intelligentes Werkzeug einkauft und in seine eigenen Arbeitsprozesse oder Portale integriert. Wenn du einen Onlineshop oder ein Serviceportal betreibst, fällst du in der Regel immer in die Rolle des Deployers.

-

Der Importer: Ein Unternehmen, das Systeme aus Drittländern in die Europäische Union einführt.

-

Der Distributor: Ein Händler, der intelligente Systeme innerhalb der Europäischen Union vertreibt.

Für Unternehmen im digitalen Handel ist vor allem die Rolle des Deployers relevant, also die Nutzung bestehender Systeme im eigenen Geschäftsalltag. Auf diese Perspektive schauen wir im weiteren Verlauf des Beitrags deshalb genauer.

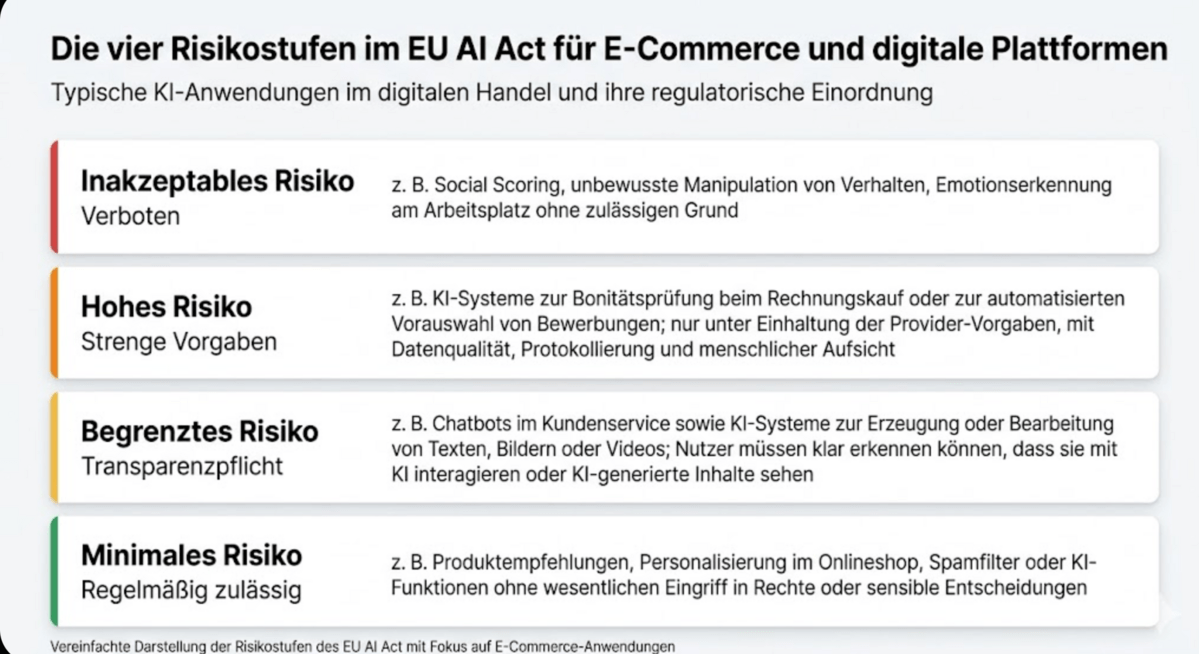

Risikostufen im AI Act: Die vier Kategorien im Detail

Das Gesetz ordnet Software nicht nach ihrer technischen Bauweise ein, sondern danach, welches potenzielle Risiko sie für die Gesellschaft, die Sicherheit oder die Grundrechte von Menschen darstellt.

-

Minimales Risiko: Die große Mehrheit der intelligenten Systeme, die wir heute nutzen, fällt in diese Kategorie. Dazu gehören intelligente Filter für unerwünschte Post oder Algorithmen in Videospielen. Hier gibt es typischerweise keine neuen gesetzlichen Pflichten und du kannst diese Werkzeuge weiterhin völlig frei nutzen.

-

Begrenztes Risiko: In diese Stufe fallen Systeme, die direkt mit Menschen interagieren oder Inhalte generieren. Der Gesetzgeber sieht hier die Gefahr, dass Menschen getäuscht werden könnten. Typische Beispiele sind digitale Assistenten im Kundenservice oder Software zur Erzeugung von künstlichen Bildern, Videos oder Texten. Die oberste Pflicht für dich als Deployer ist hier die Transparenz.

-

Hohes Risiko: Hier wird es für Unternehmen ernst. Ein hohes Risiko liegt vor, wenn die Software tiefgreifende Auswirkungen auf das Leben von Menschen hat. Das betrifft zum Beispiel Systeme zur Prüfung der Kreditwürdigkeit beim Rechnungskauf in deinem Onlineshop oder Software zur automatischen Vorauswahl von Bewerbungsunterlagen im Personalwesen. Ein ganz entscheidender Punkt für dich als Deployer: Wenn du solche Systeme einsetzt, bist du gesetzlich verpflichtet, dich absolut strikt an die Gebrauchsanweisung des Providers zu halten. Wenn in der Dokumentation steht, dass eine menschliche Kontrolle zwingend ist, und du diese Funktion abschaltest, verletzt du deine Pflichten enorm. Du musst in der Regel die Eingabedaten auf Qualität prüfen, automatische Protokolle aufbewahren und sicherstellen, dass immer eine kompetente menschliche Aufsicht vorhanden ist, die Entscheidungen der Maschine überstimmen kann.

-

Inakzeptables Risiko: Diese Systeme verstoßen gegen europäische Grundwerte und sind komplett verboten. Praktiken wie die pauschale soziale Bewertung von Menschen, die Erkennung von Emotionen am Arbeitsplatz ohne medizinischen Grund oder Techniken zur unbewussten Manipulation von Verhalten darfst du nicht einsetzen.

Der AI Act im E-Commerce: Personalisierung und dynamische Preise

Gerade im E-Business gibt es viele Anwendungen, die auf den ersten Blick ähnlich wirken, regulatorisch aber unterschiedlich zu bewerten sind. Entscheidend ist deshalb nicht nur, welche Technologie eingesetzt wird, sondern wie sie konkret im Geschäftsalltag genutzt wird.

-

Personalisierung und Produktempfehlungen: Algorithmen, die das Verhalten von Nutzern im Shop analysieren, um passende Produkte vorzuschlagen, fallen in der Regel unter das minimale Risiko. Solange diese Systeme keine Grundrechte verletzen oder in sensible Entscheidungen eingreifen, besteht hier typischerweise kein zusätzlicher Handlungsbedarf.

-

Kundenservice mit Chatbots: Anders sieht es bei digitalen Assistenten im direkten Kundenkontakt aus. Wenn ein Chatbot Anfragen zu Lieferzeiten, Retouren oder Produkten beantwortet, müssen Nutzer erkennen können, dass sie mit einem künstlichen System interagieren. Hier ist also eine klare Transparenzlösung erforderlich, etwa durch eine eindeutige Kennzeichnung direkt im Chatfenster.

-

Generierte Inhalte im Shop und im Marketing: Sobald Unternehmen Produktbilder, Werbevisuals, Videos oder Texte mithilfe von künstlicher Intelligenz erstellen, entsteht konkreter Handlungsbedarf. Entsprechende Inhalte müssen gesetzeskonform gekennzeichnet werden. Gleichzeitig ist sicherzustellen, dass maschinenlesbare Markierungen und Metadaten entlang der gesamten Prozesskette erhalten bleiben.

-

Bonitätsprüfung beim Rechnungskauf: Besonders sensibel wird es, wenn künstliche Intelligenz in Entscheidungen eingreift, die erhebliche Auswirkungen auf einzelne Personen haben. Nutzt ein Shop ein System zur Bewertung der Kreditwürdigkeit beim Rechnungskauf, sind die Anforderungen deutlich höher. In solchen Fällen müssen die Vorgaben des Providers genau eingehalten, Eingabedaten sorgfältig geprüft und eine wirksame menschliche Kontrolle sichergestellt werden.

Vorgaben der Anwendung des AI Act für Allzweckmodelle wie ChaptGPT und Gemini

Ein besonders wichtiges Thema im EU AI Act sind die sogenannten Allzweckmodelle, auf Englisch General Purpose Artificial Intelligence oder kurz GPAI. Gemeint sind damit vielseitig einsetzbare KI-Modelle, die für sehr unterschiedliche Aufgaben genutzt werden können, etwa zum Schreiben von Texten, zum Erstellen von Bildern, zur Analyse von Dokumenten oder zur Unterstützung beim Programmieren. Darunter fallen ganz konkret Tools und Modelle wie ChatGPT, Claude, Gemini oder bildgenerierende Systeme wie Midjourney und DALL·E.

Der EU AI Act behandelt diese GPAI-Modelle in einer eigenen Kategorie. Die umfangreichen Pflichten zur technischen Dokumentation, zur Einrichtung interner Richtlinien im Umgang mit Urheberrechten und zur Bewertung systemischer Risiken liegen in erster Linie beim Provider, also bei den Anbietern beziehungsweise Entwicklern dieser Modelle.

Für dich als Deployer gilt: Wenn du KI-Modelle nutzt, musst du die Transparenzpflichten des EU AI Act einhalten. Das heißt, KI-generierte Inhalte müssen klar gekennzeichnet sein und dürfen keine rechtswidrigen oder urheberrechtsgeschützten Inhalte enthalten. Für das Modell selbst bist du nicht verantwortlich, aber für den Umgang mit seinem Output.

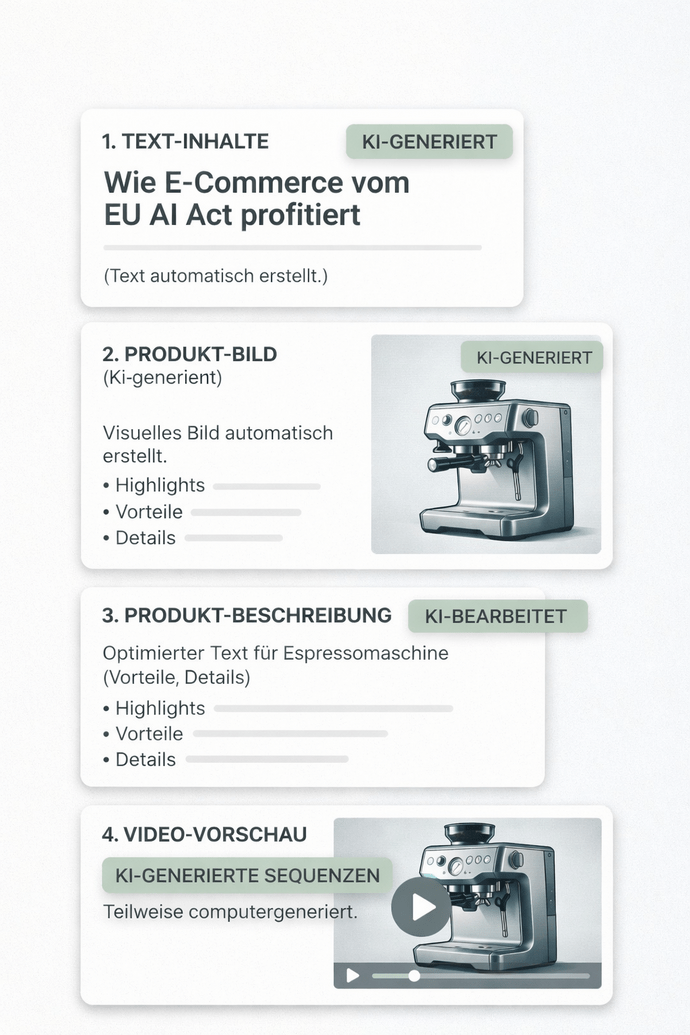

Transparenz nach dem AI Act: Worauf du bei generierten Inhalten achten musst

Wenn dein Team Bilder, Texte oder Produktvideos mit Hilfe von KI erstellt, verlangt der EU AI Act eine klare Transparenz darüber, dass diese Inhalte künstlich erzeugt oder wesentlich mit KI bearbeitet wurden. Das Gesetz schreibt dabei nicht in jedem Fall exakt ein einziges technisches Verfahren vor, sondern legt das Ziel fest: Für Nutzer muss erkennbar sein, dass der Inhalt nicht ausschließlich von einem Menschen stammt.

Konkret kann das zum Beispiel bedeuten:

- ein sichtbarer Hinweis im Shop, im Beitrag oder im Medium, dass ein Bild, Video oder Text KI-generiert ist,

- eine Kennzeichnung direkt am Content, etwa bei Produktvisuals, Kampagnenmotiven oder redaktionellen Inhalten,

- der Erhalt von Metadaten oder anderen maschinenlesbaren Markierungen, wenn diese im jeweiligen Anwendungsfall erforderlich sind.

Entscheidend ist also nicht nur, dass intern bekannt ist, wie ein Inhalt entstanden ist. Entscheidend ist, dass die künstliche Erzeugung oder Bearbeitung für Nutzer nachvollziehbar gemacht wird und keine irreführende Wirkung entsteht.

Der Sonderfall bei Texten: Wenn du künstlich erzeugte Texte veröffentlichst, die dazu bestimmt sind, die Öffentlichkeit über Themen von allgemeinem Interesse zu informieren, muss die künstliche Herkunft in der Regel klar offengelegt werden. Nutzt dein Team KI dagegen nur als Unterstützung, etwa zum Umformulieren, Kürzen oder Strukturieren von Produktbeschreibungen, greift diese Offenlegungspflicht in der Praxis typischerweise nicht in derselben Form.

Vorgaben des AI Act für interne Kontrolle und Verwaltung (Governance)

Das Gesetz verlangt in Artikel vier, dass Unternehmen eine ausreichende Kompetenz im Umgang mit künstlicher Intelligenz bei ihren Mitarbeitern sicherstellen (die sogenannte AI Literacy). Um diese gesetzlichen Vorgaben reibungslos in den Arbeitsalltag zu übersetzen, empfiehlt sich der Aufbau einer sauberen internen Steuerung, also einer echten Governance im Unternehmen.

Das bedeutet für dich in der Praxis: Rechtliche Pflichten lassen sich am besten durch klare Zuständigkeiten und definierte interne Prozesse erfüllen. Wer gibt ein neues intelligentes Werkzeug für das Marketing frei? Wer trägt die Verantwortung für die Einhaltung der Transparenz? Wie und wo werden diese Entscheidungen dokumentiert?

Idealerweise verankerst du all das in einer internen Richtlinie, die jedem Mitarbeiter klare Leitplanken gibt. Ein Entwickler muss wissen, dass er keinen sensiblen Quellcode in öffentliche Werkzeuge kopieren darf, und die Redaktion muss wissen, wie erzeugte Bilder vor der Veröffentlichung geprüft und markiert werden. Diese Strukturen führen die rechtlichen Anforderungen und deine praktische Umsetzung zusammen und schützen dein Unternehmen aktiv vor Haftungsrisiken.

Zeitplan für die Umsetzung des AI Act

Das Gesetz tritt in verschiedenen Phasen in Kraft, sodass Unternehmen Zeit haben, sich anzupassen. Bitte beachte, dass die politische Diskussion aktuell noch in vollem Gange ist. Im November des Jahres 2025 hat die Europäische Kommission ein Gesetzespaket zur Vereinfachung vorgeschlagen, den sogenannten Digital Omnibus.

Nach derzeitigem rechtlichen Stand gelten folgende Stufen:

- Ab 01. August 2024: Der Artificial Intelligence Act ist in Kraft getreten.

- Ab 02. Februar 2025: Die ersten Vorschriften wurden anwendbar. Dazu gehören insbesondere das Verbot von Systemen mit inakzeptablem Risiko sowie die Pflicht zur Kompetenz im Umgang mit künstlicher Intelligenz.

- Ab 02. August 2025: Die Vorgaben für Provider von General Purpose Artificial Intelligence Modellen beginnen zu gelten.

- Ab 02. August 2026: Der Hauptteil des Gesetzes wird anwendbar. Das betrifft unter anderem wesentliche Transparenzpflichten.

- Ab 02. Dezember 2027: Die Anforderungen für viele Hochrisiko-KI-Systeme (insbesondere eigenständige Systeme gemäß Annex III) werden nach aktueller politischer Einigung voraussichtlich erst zu diesem Zeitpunkt vollständig anwendbar.

- Ab 02. August 2028: Für KI-Systeme, die Bestandteil regulierter Produkte sind (z. B. Medizinprodukte oder Industriesysteme), gilt ein nochmals verlängerter Umsetzungszeitraum.

Hinweis zur Anpassung des Zeitplans am 31.03.26: Die EU hat im März 2026 eine Anpassung des Zeitplans beschlossen, um die Umsetzung stärker an die Verfügbarkeit technischer Standards und Normen zu koppeln. Ziel ist es, Unternehmen mehr Planungssicherheit zu geben und gleichzeitig realistische Umsetzungsbedingungen zu schaffen. Die genannten Verschiebungen betreffen vor allem komplexe Hochrisiko-Anwendungen.

Wichtig ist dabei: Es handelt sich um eine politische Einigung auf EU-Ebene. Die finale rechtliche Umsetzung im Gesetzgebungsverfahren steht noch aus. Unternehmen sollten die Entwicklung daher aktiv verfolgen und ihre KI-Systeme frühzeitig klassifizieren, um auf die unterschiedlichen Fristen vorbereitet zu sein.

Sanktionen und Bußgelder im Rahmen des AI Act

Die Europäische Union stattet das Gesetz mit empfindlichen Strafen aus. Verstöße gegen die verbotenen Praktiken können mit bis zu 35 Millionen Euro oder sieben Prozent des weltweiten Jahresumsatzes eines Unternehmens bestraft werden.

Verstöße gegen Pflichten für Provider oder Deployer, wie etwa fehlende Transparenz, können bis zu 15 Millionen Euro oder drei Prozent des Umsatzes kosten. Werden den Behörden falsche Informationen geliefert, drohen bis zu 7,5 Millionen Euro. Für kleine und mittlere Unternehmen gelten stets die niedrigeren Grenzwerte.

Zusammenfassung und Fazit zum EU AI Act

Der Artificial Intelligence Act ist kein Grund zur Sorge und darf dich nicht davon abhalten, dein Unternehmen digital weiterzuentwickeln. Er hilft dir vielmehr dabei, interne Abläufe sauber zu strukturieren, Verantwortlichkeiten bei der Nutzung von Daten zu klären und das Vertrauen deiner Kunden nachhaltig zu stärken. Wenn du verstanden hast, wo deine Systeme Daten verarbeiten und wie du künstlich erzeugte Inhalte markierst, hast du den wichtigsten Schritt bereits getan.

So unterstützt die Esono AG operativ bei der Umsetzung

Die neuen Vorgaben lassen sich am besten dann umsetzen, wenn Prozesse, Verantwortlichkeiten und technische Lösungen sauber zusammenspielen. Gerade im digitalen Handel kommt es darauf an, rechtliche Anforderungen frühzeitig mit bestehenden Systemen und internen Abläufen abzugleichen. Esono unterstützt Unternehmen dabei, den Einsatz intelligenter Systeme einzuordnen und praktikable Wege für Transparenz, interne Prozesse und die technische Umsetzung zu entwickeln.

Hinweis: Dieser Blog und unsere Dienstleistungen ersetzen keine Rechtsberatung.

Häufig gestellte Fragen zum AI Act

Der EU AI Act ist das erste umfassende Gesetz der Europäischen Union zur Regulierung von künstlicher Intelligenz. Er soll sicherstellen, dass intelligente Systeme transparent, sicher und verantwortungsvoll eingesetzt werden. Für Unternehmen ist vor allem entscheidend, welche Risiken mit einem System verbunden sind und welche Pflichten sich daraus ergeben.

Vom AI Act betroffen sind nicht nur Entwickler von künstlicher Intelligenz, sondern auch Unternehmen, die bestehende Systeme in ihrem Geschäftsalltag einsetzen. Für Onlineshops, digitale Plattformen und E-Business Unternehmen ist vor allem relevant, ob künstliche Intelligenz im Kundenkontakt, im Marketing, bei generierten Inhalten oder in sensiblen Entscheidungen genutzt wird.

Für Onlineshops ist der AI Act vor allem dort relevant, wo künstliche Intelligenz im direkten Kontakt mit Nutzern eingesetzt wird oder Inhalte für Kunden erzeugt. Besonders wichtig sind deshalb Transparenzpflichten, die Kennzeichnung bestimmter KI Inhalte und ein sauberer Umgang mit internen Prozessen und Verantwortlichkeiten.

Ja, wenn ein Chatbot direkt mit Nutzern interagiert, müssen diese in der Regel erkennen können, dass sie mit einem künstlichen System kommunizieren. In der Praxis lässt sich das meist durch eine klare Kennzeichnung direkt im Chatfenster lösen.

Ja, aber nicht automatisch im problematischen Sinn. Produktempfehlungen, Personalisierung und dynamische Preisgestaltung fallen in der Regel unter das minimale Risiko, solange sie keine Grundrechte verletzen oder in besonders sensible Entscheidungen eingreifen. In vielen Fällen besteht hier daher kein zusätzlicher Handlungsbedarf durch den AI Act.

Der AI Act ist am 1. August 2024 in Kraft getreten und wird schrittweise anwendbar. Seit dem 2. Februar 2025 gelten unter anderem die Regeln zu verbotenen Praktiken und zur AI Literacy, ab dem 2. August 2025 folgen Vorgaben für General Purpose Artificial Intelligence Modelle, ab dem 2. August 2026 der Hauptteil des Gesetzes und ab dem 2. August 2027 weitere Vorschriften für bestimmte Systeme mit hohem Risiko.

Wenn Bilder, Videos oder Texte mit künstlicher Intelligenz erzeugt werden, kann eine Kennzeichnung erforderlich sein. Entscheidend ist, dass künstlich erzeugte Inhalte für Menschen erkennbar sind und, wo nötig, auch maschinenlesbar markiert werden. Bei einfachen redaktionellen Hilfestellungen, etwa beim Kürzen oder Formulieren von Texten, greifen diese Anforderungen nicht immer in derselben Form.